ในยุคที่เทคโนโลยี AI พัฒนาอย่างรวดเร็ว มิจฉาชีพก็ใช้ประโยชน์จากมันในการสร้างข่าวปลอม ไทยรัฐออนไลน์ ใช้ AI หลอกลงทุน เพื่อหลอกลวงประชาชนให้ตกเป็นเหยื่อการฉ้อโกง สิ่งนี้เกิดขึ้นจริงเมื่อไม่นานมานี้ โดยมีการแชร์ภาพและข้อความปลอมที่แสร้งทำเป็นข่าวจากเว็บไซต์ไทยรัฐออนไลน์ ซึ่งเป็นสื่อชื่อดังของไทย

สร้างข่าวปลอม เป็น “ไทยรัฐออนไลน์” ใช้ AI ทำภาพคนดัง หลอกลวงลงทุน

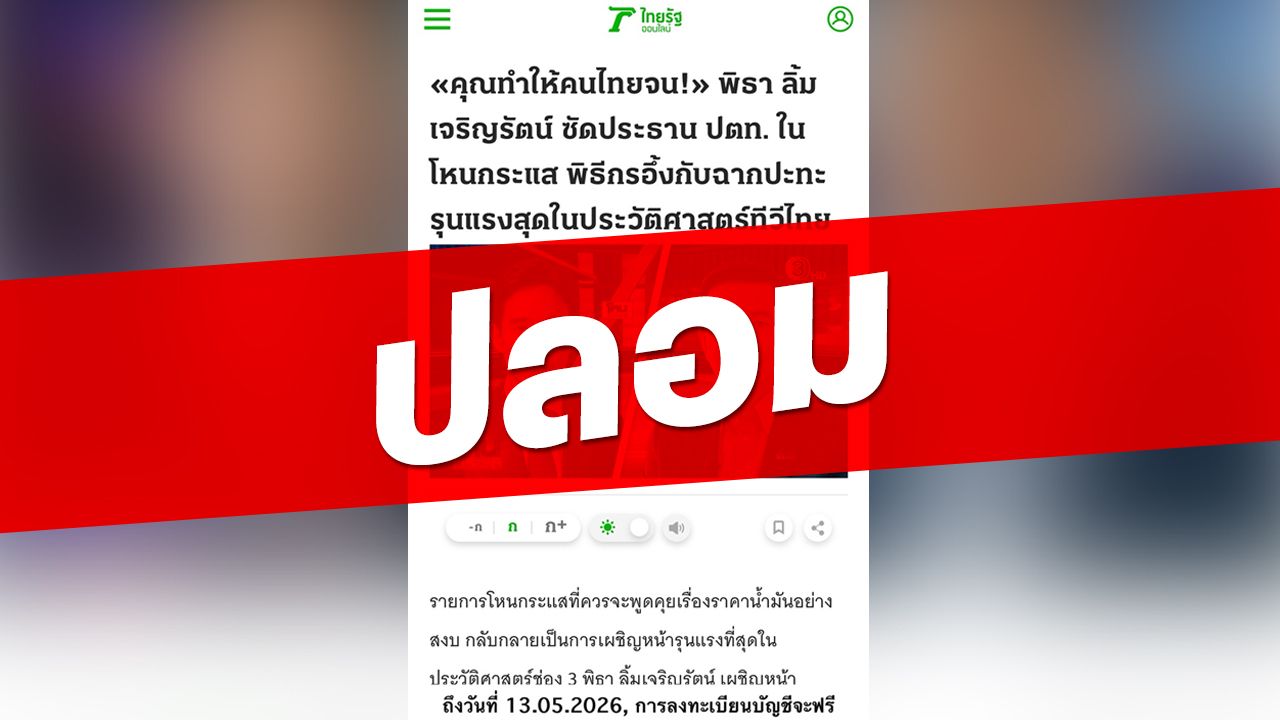

วันที่ 13 พฤษภาคม 2567 (แก้ปีจาก original 2569 คงพิมพ์ผิด) ผู้สื่อข่าวรายงานว่ามีการแพร่กระจายภาพที่สร้างด้วย AI โดยดัดแปลงหน้าเว็บไทยรัฐออนไลน์ https://www.thairath.co.th ให้ดูเหมือนเผยแพร่ข่าวจริง ข่าวปลอมเหล่านี้มีภาพนักการเมืองชื่อดังและนักธุรกิจยักษ์ใหญ่ พร้อมเนื้อหาที่ชักชวนให้ลงทุนในโครงการที่น่าสงสัย เพื่อสร้างความน่าเชื่อถือและหลอกให้คนคลิกเข้าไป

ทีมข่าวไทยรัฐยืนยันว่าเนื้อหาเหล่านี้ไม่ใช่ของไทยรัฐ แต่ถูกกลุ่มคนไม่หวังดีนำไปดัดแปลงและโพสต์ในโซเชียลมีเดีย จนเกิดการแชร์จำนวนมากและมีคอมเมนต์ไม่เหมาะสมตามมา ไทยรัฐจะแจ้งความดำเนินคดีกับผู้กระทำผิดตามกฎหมายทันที

วิธีการที่มิจฉาชีพใช้ AI สร้างข่าวปลอม

AI อย่าง Midjourney หรือ Stable Diffusion สามารถสร้างภาพสมจริงของบุคคลดังได้ง่ายๆ เพียงใส่คำสั่ง จากนั้นนำภาพไปแปะบนเทมเพลตเว็บข่าวปลอม ทำให้ดูน่าเชื่อถือ ผู้เสียหายมักถูกนำไปสู่ลิงก์หลอกลงทุนในเหรียญคริปโตหรือหุ้นปลอม

- ใช้ AI สร้างภาพนักการเมืองและ CEO ชื่อดัง

- ดัดแปลงโลโก้และเลย์เอาท์เว็บไทยรัฐ

- เนื้อหาชวนเชื่อเรื่องผลตอบแทนสูงผิดปกติ

- ลิงก์ไปยังเว็บไซต์หลอกลวงเพื่อกรอกข้อมูลส่วนตัว

อันตรายจากการหลอกลวงลงทุนด้วยข่าวปลอม

ผู้ที่หลงเชื่ออาจสูญเงินล้านบาท ถูกขโมยข้อมูลบัตรเครดิต หรือตกเป็นเหยื่อฟิชชิ่ง นอกจากนี้ยังทำให้สังคมแตกแยกเพราะข่าวเท็จเกี่ยวกับนักการเมือง ไทยรัฐเตือนให้ประชาชนตรวจสอบแหล่งข่าวเสมอ

ไทยรัฐดำเนินการอย่างไรกับข่าวปลอมนี้

ไทยรัฐออนไลน์จะร้องทุกข์ต่อเจ้าหน้าที่ตำรวจ เพื่อติดตาม IP และบัญชีผู้โพสต์ หากมีพัฒนาการจะอัปเดตให้ทราบทันที นี่เป็นตัวอย่างของการต่อสู้กับ fake news ในยุคดิจิทัล

วิธีป้องกันตัวเองจากข่าวปลอมที่ใช้ AI

เพื่อไม่ให้ตกเป็นเหยื่อสร้างข่าวปลอม ไทยรัฐออนไลน์ ใช้ AI หลอกลงทุน ให้ทำตามเคล็ดลับเหล่านี้:

- ตรวจสอบ URL: ต้องเป็น thairath.co.th จริงๆ ไม่ใช่ .com หรือ .net

- ค้นหาข่าวต้นฉบับ: พิมพ์หัวข้อในกูเกิลดูว่ามีในเว็บจริงไหม

- ดูภาพด้วย Google Reverse Image: ตรวจสอบว่าภาพถูกสร้างด้วย AI หรือไม่

- อย่าคลิกลิงก์ชวนลงทุน: โดยเฉพาะที่สัญญาผลตอบแทนสูงเกินจริง

- แจ้งเบาะแส: รายงานโพสต์ปลอมให้แพลตฟอร์มลบ

นอกจากนี้ แนะนำให้ติดตั้งส่วนขยายตรวจจับ AI-generated content ในเบราว์เซอร์ การศึกษาเกี่ยวกับ deepfake ก็ช่วยได้มาก ในยุคที่ AI เข้าถึงทุกคน ความระมัดระวังคือกุญแจสำคัญ

สรุปแล้ว การสร้างข่าวปลอม ไทยรัฐออนไลน์ ใช้ AI หลอกลงทุน เป็นภัยร้ายที่กำลังระบาด ทุกคนควรตื่นตัวและแชร์ข้อมูลจริงเพื่อต่อต้าน fake news หากคุณเจอข่าวน่าสงสัย คอมเมนต์บอกเราด้านล่าง หรือแชร์บทความนี้เพื่อเตือนเพื่อนๆ กันเถอะ!

ที่มา – สร้างข่าวปลอม เป็น “ไทยรัฐออนไลน์” ใช้ AI ทำภาพคนดัง หลอกลวงลงทุน